Hermes Agent:那个「越用越聪明」的 AI Agent,凭什么这么火?

Hermes Agent:那个「越用越聪明」的 AI Agent,凭什么这么火?

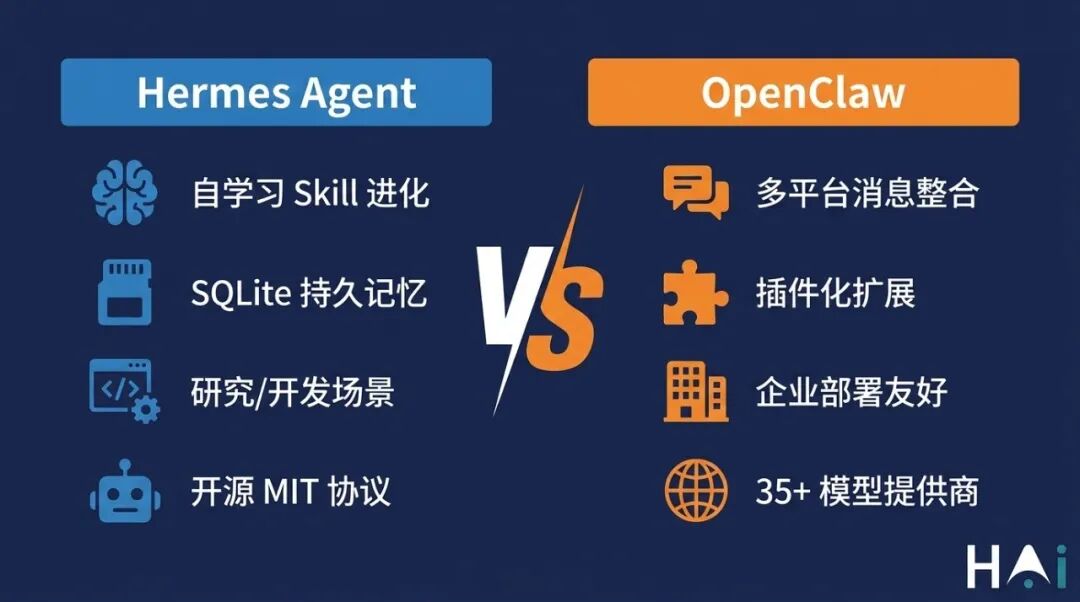

两个开源 AI Agent 框架,一个主打自我成长,一个主打多平台整合。到底谁更适合你?

最近技术圈有一个项目被频繁提起,叫 Hermes Agent。

不是某家大厂出品,是 Nous Research(就是做 Hermes 系列大模型的那个实验室)开源的 AI Agent 框架。GitHub 上目前10w + stars,上线没多久社区已经相当活跃。

有人说它"像 OpenClaw 加上了一周的手动调试 + RAG + 记忆持久化 + 更好的工具调用"。

这个比较挺有意思的。OpenClaw 我们用了一段时间,也比较熟,这篇就聊聊这两个东西到底有什么异同,以及各自适合什么场景。

先说 Hermes Agent 是什么

Hermes Agent 是一个开源 AI Agent(MIT 协议),核心卖点是「闭环学习」。

大多数 Agent 框架是这样的:你说一件事,它做,做完了。下次同样的事,重新来过,没有记忆、没有沉淀。

Hermes Agent 想干掉这个问题。它的设计逻辑是:

完成任务 → 保存经验 → 生成 Skill → 下次直接调用

这个"Skill"不是抽象的东西,是实实在在的结构化 Markdown 文件,记录了操作步骤、踩过的坑、验证方法。再碰到类似任务,它不用从头摸索,直接读文件就行。

除了 Skill 系统,它还有几个值得关注的设计:

· 真正的持久记忆:用两个文件管理上下文——MEMORY.md(环境知识、规范、教训,约 800 tokens 上限)和 USER.md(你的习惯和偏好,约 500 tokens),每次会话开始时注入 system prompt。历史会话存 SQLite + FTS5 全文索引,支持跨会话语义搜索,能回忆几周前的内容。另外内置了包括 Honcho 在内的外部记忆提供商插件,可按需扩展。

· 跑在你自己的机器上:支持 6 种终端后端——本地、Docker、SSH 远程服务器、Singularity(HPC 集群)、Modal 和 Daytona。其中 Daytona 和 Modal 提供 serverless 持久化环境,空闲时几乎零成本。

· 47 个内置工具:网络搜索、文件操作、终端命令、图片生成、TTS、视觉理解……开箱即用,不用额外配置。

· MCP 集成:支持 Model Context Protocol,可以接入 GitHub、数据库或任何暴露了 MCP 端点的服务,几行配置就能扩展。

· 模型无关:OpenAI、Anthropic、Google、Nous Portal、OpenRouter、本地 Ollama/vLLM/SGLang 都行,切换只需一条命令,不改代码。

· 跨平台控制界面:从一个 Gateway 管理 Telegram、Discord、Slack、WhatsApp、Signal、Matrix、Mattermost、Email、SMS、DingTalk、Feishu、WeCom 等 15+ 个平台。在哪个 app 发消息都能控制 Agent。

OpenClaw 是什么路子

OpenClaw 的出发点不一样。

它的核心定位是:把各种消息平台变成你的 AI Agent 控制台。

简单说就是,你在 WhatsApp 给它发条消息,它去帮你做事。整个交互界面就是你日常用的聊天 app,不用学新工具,不用开什么 Dashboard。

它目前支持的渠道相当全:

· 内置渠道:Discord、Google Chat、Signal、Slack、Telegram、WebChat、WhatsApp 等

· 内置插件渠道:BlueBubbles(iMessage)、Feishu(飞书)、LINE、Matrix、Mattermost、Microsoft Teams、Nextcloud Talk、Nostr、QQ Bot、Twitch、Zalo 等

· 可选独立安装:WeChat 等第三方插件可进一步扩展

国内平台(飞书、QQ Bot)到国际主流(Discord、Telegram、Slack、WhatsApp)全覆盖,一个 Gateway 统一管理。

架构上它有个本地 Gateway(控制平面),统一管理 sessions、channels、工具和事件。同一个 Agent 可以跨平台收发消息,同时响应来自不同渠道的请求。

模型侧支持 35+ 家提供商(Anthropic、OpenAI、Google 等),也支持 vLLM、SGLang、Ollama 等自托管端点。

另外它也有 Skill 系统——通过安装 Skill 扩展能力,有一个社区 Skill 市场(ClawHub)。Skills 主要是人工编写的,代码质量可控、可审计,扩展路径是人驱动的。

两者的核心差异

硬要用一句话概括:

Hermes Agent = 自我成长的研究型 Agent

OpenClaw = 全平台打通的消息指挥中心

展开说:

自学习能力

Hermes 最大的差异点就在这里。它有一套完整的"经验 → 技能"转化机制:Agent 在完成复杂任务(5+ 次工具调用)、走出死路、或者被用户纠正之后,会主动把这段经历转化成结构化的 Skill 文档。干得越多,沉淀的 Skill 越多,之后类似任务就越快、越准。这个闭环是系统性设计出来的,不是噱头。

OpenClaw 也有 Skill 系统,但 Skills 是人工编写、手动安装的。这很好——代码质量可控、可审计——但扩展路径是人驱动的,不是 Agent 自己生长的。

平台覆盖

两者在平台覆盖上都相当完整,侧重略有不同。

OpenClaw 渠道覆盖全面,内置 + 插件覆盖国内外主流平台:Discord、Telegram、WhatsApp、Signal、Slack 等国际平台,以及飞书、QQ Bot 等国内平台均有支持,WeChat 可通过第三方插件接入。整个渠道体系由统一 Gateway 管理。

Hermes 官方文档标注支持 15+ 个平台,覆盖 Telegram、Discord、Slack、WhatsApp、Signal、Matrix、Mattermost、Email、SMS、DingTalk(钉钉)、Feishu(飞书)、WeCom(企业微信)等,国内外主流渠道基本都有。

研究与工程向工具

Hermes 有个不寻常的功能:批量任务处理(batch_runner)、Atropos RL 训练环境……这些是给 AI 研究者用的,配合 Nous Research 自己的 Hermes/Nomos/Psyche 模型生态,适合做 Agent 底层研究和训练数据收集。

OpenClaw 没有这个方向,它不是科研工具,是生产工具。

技术栈

Hermes 用 Python,模型无关,支持各种本地推理后端(Ollama、vLLM、SGLang)。

OpenClaw 用 Node.js,也是模型无关,有个统一的 API 层对接 35+ 家 LLM 服务。

各自适合什么场景

这两个项目其实不太构成直接竞争,针对的场景有明显区别:

选 Hermes Agent 如果你……

· 想让 Agent 在长期使用中真正变聪明、积累经验

· 做 AI 研究、需要轨迹数据和 RL 训练环境

· 以 Python 栈为主,喜欢接本地模型

· 需要 MCP 协议做服务集成

· 使用 Telegram/Discord 等作为主要控制界面

选 OpenClaw 如果你……

· 需要在多个消息平台(尤其是国内外并重)统一管理 Agent

· 团队已经在用飞书/钉钉/企业微信作为主要沟通工具

· 更看重稳定性和可控的 Skill 管理

· 偏向 Node.js 生态

· 有企业级部署需求

当然,两者都在快速迭代,功能边界也在模糊。Hermes 的平台支持在增加,OpenClaw 的记忆和自学习能力也在演进。

模型选择这件事,两者都绕不开

不管用哪个框架,有一件事是共同的:底层接的是哪个大模型,直接决定 Agent 的能力上限。

Agent 框架再好,推理能力差的模型照样给你交废答案。工具调用、指令理解、多轮对话——这些都高度依赖底层模型的质量。

Hermes Agent 支持通过 Nous Portal、OpenRouter、OpenAI、Anthropic、Google,或者本地 Ollama/vLLM/SGLang 接入模型,本质上是在一个统一接口下按需切换。这个思路很实用——需要推理能力就调强模型,需要快速响应就换小模型,成本可控。

HAI 做的也是类似的事。通过 portal.hai.network,可以一站接入包括 Anthropic、OpenAI、Google、DeepSeek、Qwen、GLM、Kimi 等主流厂商模型,统一 API 格式,按量计费,不用对每家厂商单独申请账号和做接口适配。

对于想跑 Hermes Agent 或 OpenClaw 的开发者来说,接 HAI 是个省事的选项——框架配一次,模型随时换,不影响上层逻辑。

小结

Hermes Agent 的出现,让"AI Agent 真正学东西"这件事从设想变成了可部署的系统。它的闭环学习机制、持久记忆、Skill 自生成,代表了一种不同的 Agent 设计哲学:不要每次从零开始,让 Agent 随着使用积累真正的能力。

OpenClaw 则在消息平台整合这个方向上走得很深,如果你的核心诉求是"让 Agent 渗透进日常通讯流",它目前是最完整的选项之一。

两个项目都值得关注,选哪个主要看你的业务场景和技术偏好。

对开发者来说,更值得关心的可能是:不管跑什么框架,底层的模型调用效率和成本,才是长期跑起来的关键变量。

Build with HAI|portal.hai.network,一站接入全球顶尖 AI 模型。